ຄວາມປອດໄພຂອງ AI? ຄໍາຖະແຫຼງ Bletchley Park ແມ່ນສໍາຄັນ

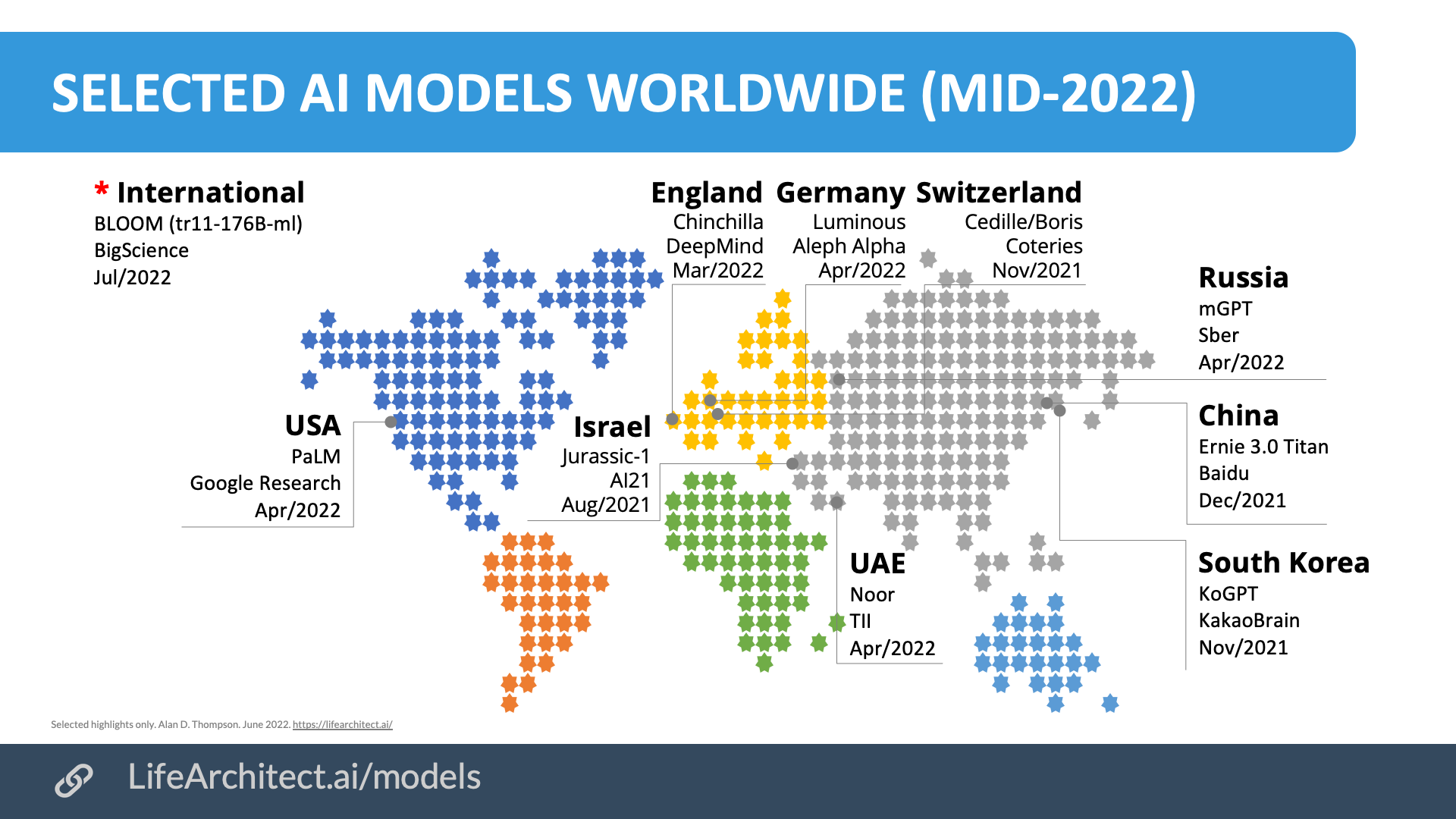

ໂດຍລະອຽດເຖິງຂໍ້ລິເລີ່ມທີ່ສຳຄັນ ທີ່ຖືກລົງໂທດໂດຍບັນດາປະເທດຕົ້ນຕໍ ທີ່ເປັນຕົວເອກຂອງຄວາມຄືບໜ້າຂອງໂລກ ໃນຂົງເຂດປັນຍາປະດິດ.

ໃນວັນທີ 1 ແລະວັນທີ 2 ພະຈິກຜ່ານມານີ້, ໃນລະຫວ່າງທີ່ ກອງປະຊຸມສຸດຍອດຄວາມປອດໄພ AI, ຈັດຂຶ້ນຢູ່ປະເທດອັງກິດຢູ່ ສວນສາທາລະນະ Bletchleyໃນເຂດ Buckinghamshire, 28 ປະເທດໄດ້ລົງນາມໃນຖະແຫຼງການກ່ຽວກັບການພັດທະນາປັນຍາທຽມໃນສະພາບທີ່ປອດໄພ.

AI: ສົງຄາມທີ່ກໍາລັງຈະແຕກອອກຈະບໍ່ເປັນໄປຕາມທີ່ພວກເຮົາຄາດຫວັງ

SwissGPT: Swiss AI ທີ່ປະຕິວັດຄວາມປອດໄພຂອງບໍລິສັດ

ຮູບພາບ, ອະນາຄົດຂອງການຫັນເປັນດິຈິຕອນໃນ Liechtenstein

ສະຖານທີ່ທີ່ມີຄ່າສັນຍາລັກສູງ, ດີກວ່າ ຫຼື ຮ້າຍແຮງກວ່າ...

ສະຖານທີ່ກອງປະຊຸມສຸດຍອດໄດ້ຈັດຂຶ້ນ, ສວນສາທາລະນະ Bletchley, ເປັນສູນຖອດລະຫັດໃນໄລຍະສົງຄາມໂລກຄັ້ງທີສອງບ່ອນທີ່ Alan Turing ແລະທີມງານຂອງລາວໄດ້ເຮັດວຽກໃນການສ້າງ "Christopher”, ເຄື່ອງຄອມພິວເຕີທີ່ຄຸ້ມຄອງເພື່ອທໍາລາຍລະຫັດຂອງ Enigma, ເປັນອຸປະກອນຂອງເຢຍລະມັນໃຊ້ເພື່ອເຂົ້າລະຫັດຂໍ້ຄວາມລັບຂອງທະຫານຈົນກ່ວາຫຼັງຈາກນັ້ນພິຈາລະນາຄະນິດສາດ unassailable.

ສະຖານທີ່ທີ່ມີມູນຄ່າສັນຍາລັກສູງໂດຍສະເພາະ, ຍ້ອນວ່າມັນໄດ້ຖືກຄິດໄລ່ວ່າຍ້ອນນັກວິຊາການອັງກິດສົງຄາມໃຊ້ເວລາຫນ້ອຍລົງສອງປີ, ຊ່ວຍຊີວິດຢ່າງຫນ້ອຍ 14 ລ້ານຄົນ.

ແຕ່ຫນ້າເສຍດາຍ, ສະຖານທີ່ດຽວກັນຍັງສະແດງເຖິງຄວາມ indifference ພື້ນຖານແລະຄວາມກະຕືລືລົ້ນຂອງຫຼາຍລັດຖະບານຕໍ່ຜູ້ຊ່ອຍໃຫ້ລອດຂອງພວກເຂົາ, ເພາະວ່າ Alan Turing ໄດ້ຂ້າຕົວຕາຍໃນປີ 1954 ຫຼັງຈາກ "ການຖິ້ມສານເຄມີ" ເປັນເວລາຫນຶ່ງປີຂອງລາວສໍາລັບການຮັກຮ່ວມເພດຂອງລາວ, ດ້ວຍການສິ້ນສຸດຂອງກະສັດ ". ການໃຫ້ອະໄພຢ່າງບໍ່ຢຸດຢັ້ງ” ໃນປີ 2013, ເໝືອນກັບວ່າລາວເປັນຜູ້ທີ່ຕ້ອງແກ້ໄຂບາງຢ່າງ.

ທັງຫມົດນີ້ຍັງເຮັດໃຫ້ພວກເຮົາສົງໄສກ່ຽວກັບວິທີການໃນປະຈຸບັນຂອງອໍານາດການປົກຄອງສູງສຸດຕໍ່ກັບບັນຫາທີ່ເປີດໂດຍ "ການລະເບີດ" ທີ່ຜ່ານມາຂອງເຕັກໂນໂລຢີທີ່ເຊື່ອມຕໍ່ກັບ Artificial Intelligence.

ສະວິດເຊີແລນແລະອາເມລິກາສອດຄ່ອງກັບຄວາມປອດໄພທາງອິນເຕີເນັດແລະເຕັກໂນໂລຊີດິຈິຕອນ

ນ້ຳ, ຫຍ້າ ແລະ ມະນຸດ: ຂີດຈຳກັດທາງດ້ານສະຕິປັນຍາຂອງປັນຍາປະດິດ

ປັນຍາທຽມຍັງສໍາລັບການພັດທະນາຢາໃຫມ່

ແຕ່ໃຫ້ເຮົາມາເບິ່ງວ່າ ການປະກາດຄວາມຕັ້ງໃຈມີຫຍັງແດ່

ຫຼັງຈາກການວິເຄາະສະຫຼຸບກ່ຽວກັບໂອກາດສໍາລັບການປັບປຸງທີ່ສະເຫນີໂດຍ AI ໃນຂະແຫນງຕ່າງໆຂອງກິດຈະກໍາຂອງມະນຸດແລະການຮັບຮູ້ວ່າເຕັກໂນໂລຢີທີ່ເຊື່ອມຕໍ່ກັບມັນໃນປັດຈຸບັນແມ່ນແຜ່ຂະຫຍາຍ, ຄວາມຕ້ອງການສໍາລັບການພັດທະນາທີ່ປອດໄພຂອງພວກເຂົາແລະເພື່ອຮັກສາຄວາມຕ້ອງການຂອງຊະນິດພັນຂອງພວກເຮົາຢູ່ສະເຫມີ. ກາງ.

ຫຼັງຈາກນັ້ນ, ຊຸດຂອງຄວາມສ່ຽງທີ່ເປັນໄປໄດ້ໄດ້ຖືກລະບຸໄວ້, ບາງອັນໄດ້ຖືກກວດສອບແລ້ວໃນພາກສະຫນາມ, ການເຊື່ອມໂຍງກັບການນໍາໃຊ້ລະບົບ AI, ແລະໂດຍສະເພາະ: ຄວາມສ່ຽງທີ່ເກີດຂື້ນກັບສິດທິມະນຸດ (ການເຮັດວຽກ, ການດູແລ, ຍຸດຕິທໍາ); ຄວາມສ່ຽງຕໍ່ການປ້ອງກັນຄວາມເປັນສ່ວນຕົວ; ຄວາມສ່ຽງທີ່ເຊື່ອມໂຍງກັບຂໍ້ມູນທີ່ຖືກຕ້ອງ (ເນື້ອຫາທີ່ເຮັດໃຫ້ເຂົ້າໃຈຜິດທີ່ຫນ້າເຊື່ອຖືທີ່ສຸດ); ຄວາມສ່ຽງທີ່ເຊື່ອມຕໍ່ກັບ "singularities" ເຕັກໂນໂລຢີທີ່ເຊື່ອມຕໍ່ກັບ AI (ເຕັກໂນໂລຢີທີ່ຂັດຂວາງໃຫມ່ໃນສະພາບການທີ່ລະອຽດອ່ອນເຊັ່ນ: ເຕັກໂນໂລຢີຊີວະພາບແລະເຕັກໂນໂລຢີຂໍ້ມູນຂ່າວສານ).

ໃນສະວິດເຊີແລນ, ລັດວິສາຫະກິດໂພລີເທກນິກຂອງລັດຖະບານກາງສໍາລັບ AI ໂປ່ງໃສແລະເຊື່ອຖືໄດ້

Artificial Intelligence ແມ່ນ (ຍັງ) ການປະຕິວັດໃນການແກ້ໄຂຮູບພາບ

ນະວັດຕະກໍາ ແລະ ວາລະສານ: ການຢູ່ຮ່ວມກັນທີ່ຍາກຫຼາຍ

ການຄຸ້ມຄອງບັນຫານອກຊາຍແດນຂອງລັດ

ເນື່ອງຈາກວ່າຫຼາຍຄວາມສ່ຽງເຫຼົ່ານີ້ແມ່ນພາຍໃນທໍາມະຊາດຢູ່ໃນສາກົນ, ການຮ່ວມມືສູງສຸດລະຫວ່າງລັດແມ່ນແນະນໍາໃຫ້ແກ້ໄຂໃຫ້ເຂົາເຈົ້າໃນຂະນະທີ່ພວກເຂົາເກີດຂຶ້ນ, ເຊັ່ນດຽວກັນກັບການມີສ່ວນຮ່ວມຢ່າງຫ້າວຫັນຂອງນັກສະແດງທັງຫມົດເລີ່ມຕົ້ນຈາກບໍລິສັດທີ່ໃຫຍ່ທີ່ສຸດແລະສໍາຄັນທີ່ສຸດ, ດັ່ງນັ້ນຈຶ່ງສາມາດ "ຝຶກອົບຮົມ" ມີອໍານາດຫຼາຍທີ່ສຸດ. AI, ໃນການປຽບທຽບຢ່າງຕໍ່ເນື່ອງ, ເປີດແລະໂປ່ງໃສ.

ດັ່ງນັ້ນ, ເຄືອຂ່າຍຂອງການຮ່ວມມືຈະຖືກສ້າງຂື້ນໃນລະດັບໂລກໂດຍມີຈຸດປະສົງເພື່ອກໍານົດຄວາມສ່ຽງຂອງປັນຍາປະດິດໂດຍຜ່ານວິທີການວິທະຍາສາດທົ່ວໂລກແລະຮ່ວມກັນເພື່ອເຂົ້າໃຈຜົນກະທົບຂອງມັນຕໍ່ສັງຄົມແລະດັ່ງນັ້ນຈຶ່ງສ້າງນະໂຍບາຍທົ່ວໄປເພື່ອແກ້ໄຂການປ່ຽນແປງທີ່ກ່ຽວຂ້ອງ.

Michael von Liechtenstein ກ່ຽວກັບພູມສາດການເມືອງແລະປັນຍາປະດິດ

ເມື່ອອາຍຸແກ່ແມ່ນເສັ້ນແບ່ງລະຫວ່າງເຕັກໂນໂລຢີທີ່ດີແລະບໍ່ດີ

ຮູບແບບຂໍ້ມູນໃຫຍ່ຂອງ “ວັນສະຖິຕິສະວິດ 2023”

ຄວາມສ່ຽງຂອງວິທີການເທິງລົງລຸ່ມໃນການຄຸ້ມຄອງຫົວຂໍ້

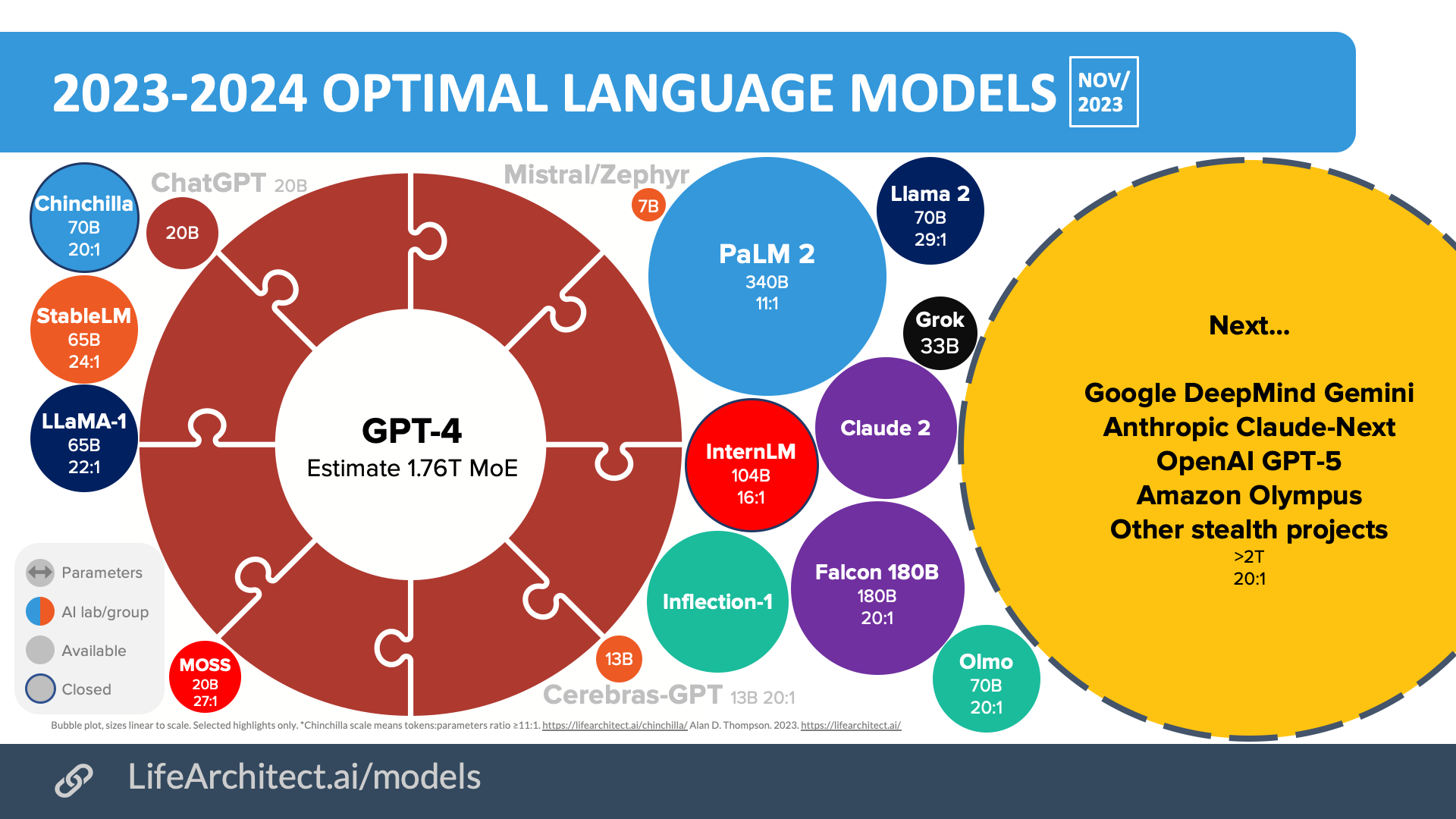

ຜູ້ຊ່ຽວຊານດ້ານອຸດສາຫະກໍາຈໍານວນຫນຶ່ງຊີ້ໃຫ້ເຫັນວ່າ, ນອກເຫນືອຈາກຄວາມຕັ້ງໃຈທີ່ດີແລະການປະກາດທີ່ຕ້ອງການທີ່ຈະສືບຕໍ່ການສົນທະນາທີ່ເປີດກວ້າງກັບຜູ້ຫຼິ້ນທັງຫມົດ, ວິທີການ "ເທິງລົງລຸ່ມ" ມີຄວາມສ່ຽງ "ຜູກມື" ພຽງແຕ່ຂອງບໍລິສັດຂະຫນາດໃຫຍ່ໃນຂະແຫນງການ, ແທນທີ່ຈະອອກຈາກ ຂະຫນາດນ້ອຍກວ່າແລະດັ່ງນັ້ນຈຶ່ງຍາກທີ່ຈະຄວບຄຸມຫນ່ວຍງານທີ່ບໍ່ເສຍຄ່າກັບທຸກຄົນ.

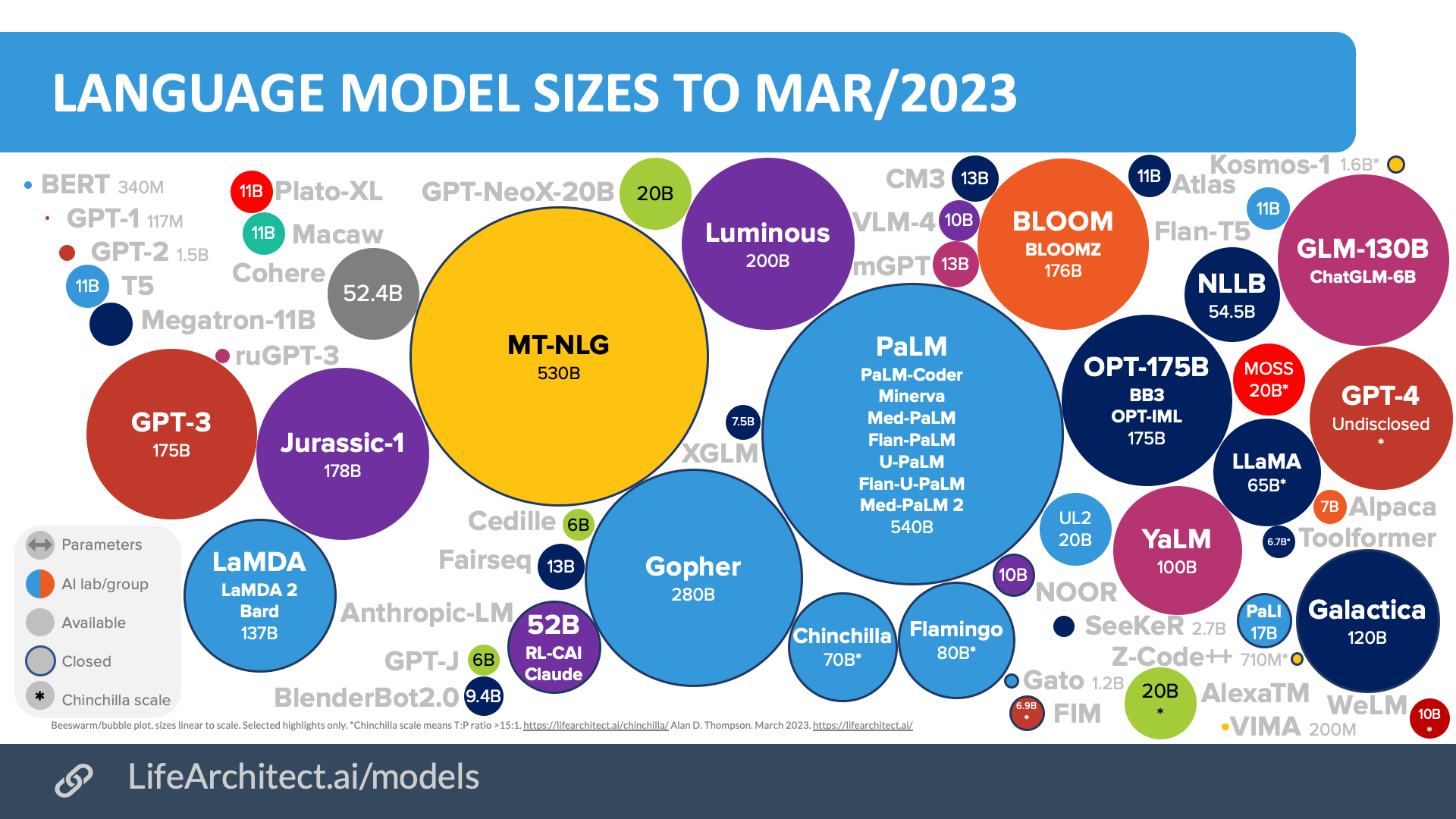

ເຫຼົ່ານີ້ແມ່ນຄວາມເປັນຈິງທີ່ຈະແຜ່ຂະຫຍາຍຫຼາຍຂື້ນແລະຊັດເຈນຍ້ອນເຕັກໂນໂລຢີເຫຼົ່ານັ້ນ, ປະຈຸບັນຖືກພັດທະນາໂດຍບໍລິສັດເຊັ່ນ Google ແລະ OpenAI, ເຊິ່ງຈະຊ່ວຍໃຫ້ລະບົບ AI ປັບແຕ່ງສ່ວນບຸກຄົນໄດ້ຫຼາຍຂື້ນຍ້ອນການເພີ່ມປະສິດທິພາບຂອງຊັບພະຍາກອນທີ່ຈໍາເປັນ, ບາງທີອາດດໍາເນີນການຢູ່ໃນຂອບເຂດຈໍາກັດທາງດ້ານກົດຫມາຍ. .

ໃນສັ້ນ, ດັ່ງທີ່ຄໍາສາບແຊ່ງຂອງຈີນບູຮານເວົ້າວ່າ, ເວລາທີ່ຫນ້າສົນໃຈແມ່ນຢູ່ຂ້າງຫນ້າ.

ຄວາມເຊື່ອທີ່ກ້າວກະໂດດຢ່າງຖາວອນນັ້ນຢູ່ໃນໂຮງໜັງຂອງ Christopher Nolan

ແຜນທີ່ເສັ້ນທາງເພື່ອສົ່ງເສີມ Liechtenstein ເປັນສູນກາງດິຈິຕອນ

ໃນ Frauenfeld, AI ກໍາລັງຂັບລົດໂຮງງານຈັດລຽງ PET ໃຫມ່

ສິ່ງທີ່ເກີດຂຶ້ນແທ້ໆໃນກອງປະຊຸມສຸດຍອດຄວາມປອດໄພທາງປັນຍາທຽມປີ 2023 ຢູ່ Bletchley Park

ການເປີດກອງປະຊຸມຄົບຄະນະຂອງກອງປະຊຸມສຸດຍອດຄວາມປອດໄພທາງປັນຍາທຽມ 2023 ທີ່ Bletchley Park

ພິທີປິດກອງປະຊຸມສຸດຍອດຄວາມປອດໄພທາງປັນຍາທຽມ 2023 ທີ່ Bletchley Park

ຂໍ້ຄວາມຂອງກະສັດ Charles III ແຫ່ງອັງກິດຕໍ່ສາທາລະນະຊົນແລະຜູ້ຈັດຕັ້ງກອງປະຊຸມສຸດຍອດຄວາມປອດໄພ AI 2023

ທ່ານອາດຈະສົນໃຈໃນ:

"ຂ້ອຍຂາຍ, ແຕ່ຂ້ອຍຢູ່": ແນວໂນ້ມໃຫມ່ຂອງຜູ້ປະກອບການຂະຫນາດນ້ອຍ

ເລື່ອງຂອງ Francesco Schittini ແລະ Emotec ເຂົ້າໄປໃນກອງທຶນ MCP ແມ່ນຕົວຢ່າງຂອງການປ່ຽນແປງການເປັນເຈົ້າຂອງເລື້ອຍໆໂດຍບໍ່ມີການຕົກຕະລຶງໃນອົງການຈັດຕັ້ງ.

ໂດຍ Alberto Nicoliniບັນນາທິການຂອງ districtbiomedicale.it, ຂ່າວ BioMed ແລະວິທະຍຸ Pico

ເຄື່ອງມື AI ສໍາລັບທຸລະກິດ, ຫຼັກສູດທີ່ອຸທິດຕົນເພື່ອປັນຍາປະດິດ

navAI ເລີ່ມຕົ້ນຂອງສະວິດເຊີແລນໄດ້ພັດທະນາມັນໂດຍມີຈຸດປະສົງເພື່ອສະຫນອງເຄື່ອງມືທັງຫມົດທີ່ຈໍາເປັນເພື່ອປະຕິບັດເຕັກໂນໂລຢີໃຫມ່ໃນຂະແຫນງການຂອງຕົນ.

ມີ backdoor ທີ່ຈະຕິດເຊື້ອໃຫ້ເຂົາເຈົ້າທັງຫມົດ, ແຕ່ genius ຫນຶ່ງໄດ້ຊ່ວຍປະຢັດເວັບ

ນີ້ແມ່ນວິທີການທີ່ມີຄວາມຊໍານານຂອງຜູ້ພັດທະນາ, ແລະເລັກນ້ອຍ ... ຜູ້ໃຫ້ບໍລິການ, ພຽງແຕ່ປ້ອງກັນການລ່ວງລະເມີດຂອງ Linux ແລະອິນເຕີເນັດທັງຫມົດ.

ການປົກປັກຮັກສາທະເລໃນປະເທດເກຼັກແລະບັນຫາຂອງ Hellenic Trench…

"ກອງປະຊຸມມະຫາສະຫມຸດຂອງພວກເຮົາ", Athens ຈະສ້າງສອງສວນສາທາລະນ້ໍາແຫ່ງຊາດໃຫມ່ແລະຫ້າມ trawling, ແຕ່ມີບັນຫາລະຫວ່າງ Aegean ແລະ Ionian.